Reconnaissance des émotions faciales à travers des caractéristiques profondes

Contexte :

La reconnaissance automatique des émotions faciales (FER) joue un rôle important dans les interactions homme–machine et les applications en intelligence artificielle. Cependant, cette tâche reste complexe en raison de la variabilité des expressions faciales, des conditions d’acquisition (éclairage, pose) et du manque de données annotées de grande taille.

Objectif :

Développer un système automatique de reconnaissance des émotions faciales basé sur des caractéristiques profondes, capable d’obtenir de bonnes performances et de généraliser sur des bases de données de taille limitée.

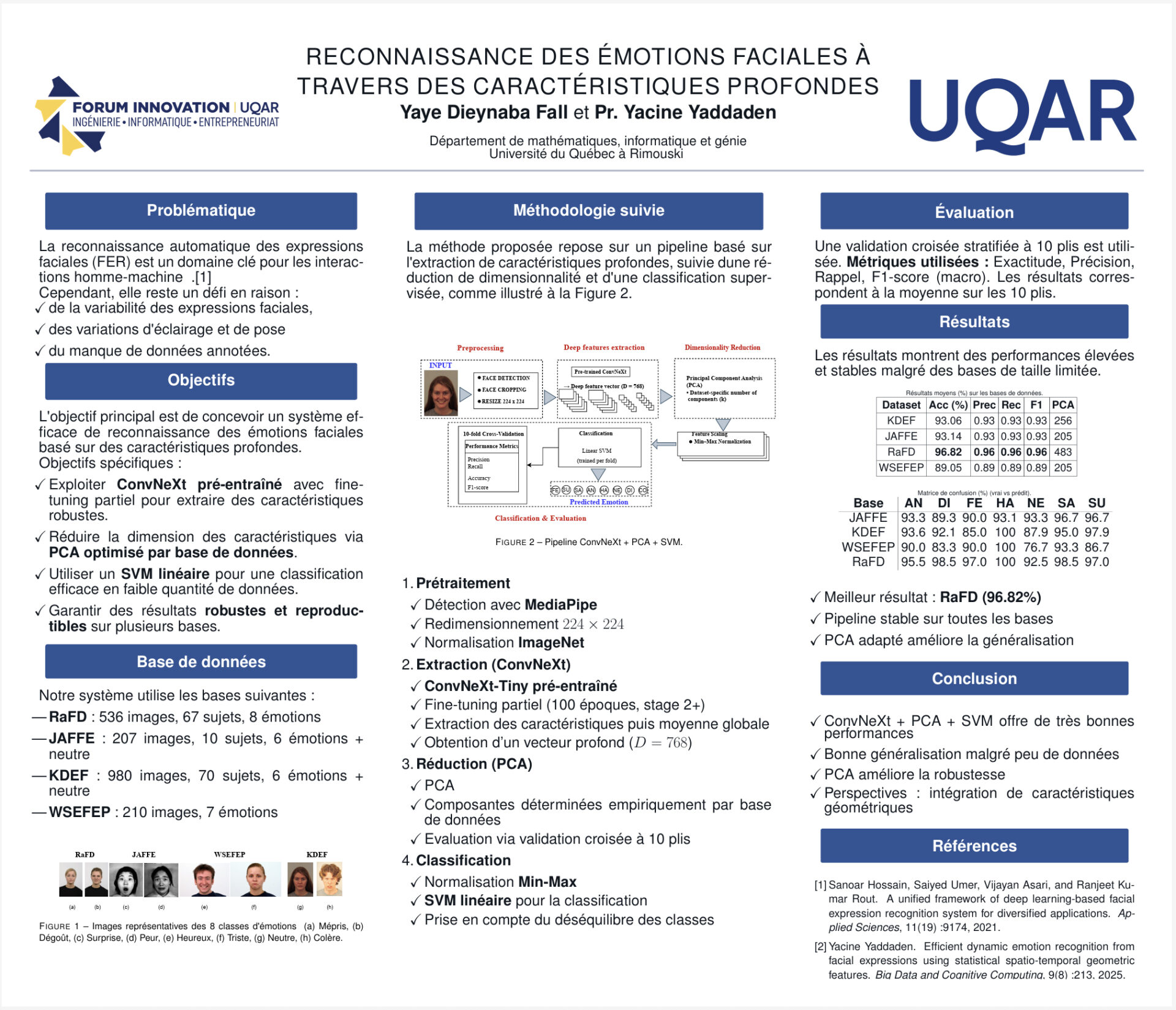

Méthodologie :

Utilisation de plusieurs bases de données : JAFFE, KDEF, WSEFEP et RaFD.

Prétraitement des images : détection des visages, recadrage, redimensionnement et normalisation.

Extraction des caractéristiques profondes à l’aide du modèle ConvNeXt pré-entraîné avec fine-tuning partiel.

Réduction de dimension par PCA avec un nombre de composantes déterminé empiriquement pour chaque base.

Classification des émotions à l’aide d’un SVM linéaire avec prise en compte du déséquilibre des classes.

Évaluation avec une validation croisée stratifiée à 10 plis.

Utilisation des métriques : Exactitude, Précision, Rappel et F1-score.

Résultats :

Les résultats obtenus montrent des performances élevées et stables sur l’ensemble des bases de données, avec une exactitude atteignant 96.82 % sur la base RaFD. L’approche proposée démontre une bonne capacité de généralisation malgré la taille limitée des données.

Conclusion :

L’approche basée sur les caractéristiques profondes combinées à la PCA et au SVM permet une reconnaissance efficace et robuste des émotions faciales. Des perspectives d’amélioration incluent l’intégration de nouvelles caractéristiques, notamment géométriques, afin d’augmenter encore les performances.

Présenté par

Yaye Dieynaba Fall

Maitrise informatique Lévis

Volet Recherche 3017