Reconnaissance des émotions faciales par deep learning en environnements contrôlé et réel

- Contexte : Analyser les expressions faciales pour reconnaître automatiquement les émotions, un enjeu important en intelligence artificielle (santé, sécurité, interaction homme-machine).

- Objectif : Développer un système basé sur le deep learning capable de reconnaître les émotions faciales et de s’adapter à des données en conditions contrôlées et réelles (in-the-wild).

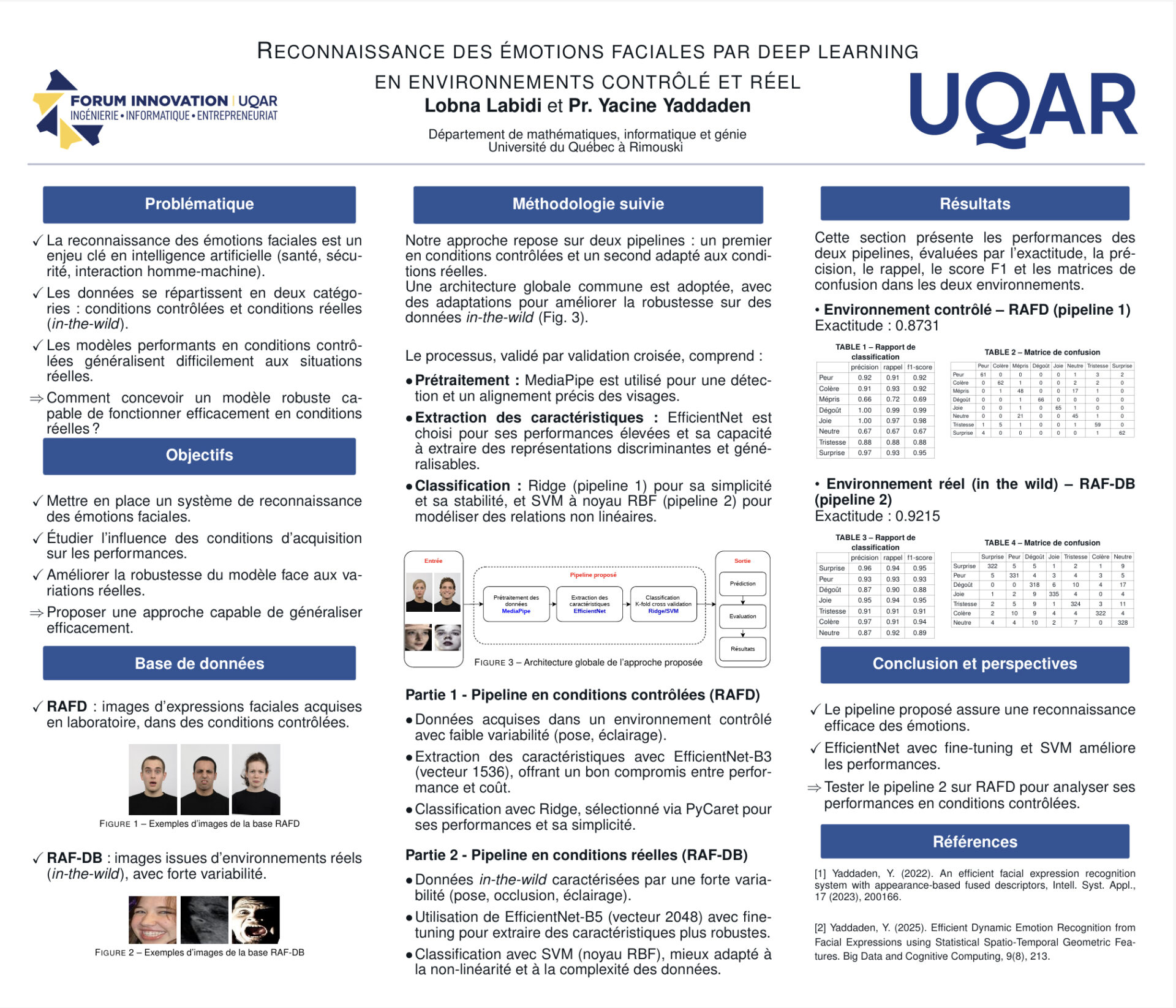

- Méthodologie : – Utilisation des bases de données RAFD (contrôlée) et RAF-DB (réelle).

– Prétraitement des images (détection et alignement avec MediaPipe).

– Extraction des caractéristiques avec EfficientNet.

– Classification avec Ridge (pipeline 1) et SVM (pipeline 2). - Résultats : Les performances obtenues montrent une reconnaissance efficace des émotions, avec de meilleurs résultats en conditions réelles grâce à l’adaptation du modèle.

- Conclusion : L’approche proposée améliore la robustesse et la capacité de généralisation du modèle face aux variations des données.

Présenté par

Lobna Labidi